Narzędzia użytkownika

Narzędzia witryny

Pasek boczny

statpqpl:metapl:asymetr

Badanie asymetrii

Symetria w uzyskanych efektach zwykle świadczy o braku obciążenia publikacyjnego, należy jednak pamiętać, że wiele obiektywnych czynników może zakłócić symetrię np. często nie są publikowane badania o nieistotnych statystycznie efektach lub badania małe, co znacznie utrudnia dotarcie do takich wyników. Jednocześnie brak jest dostatecznie wszechstronnych i uniwersalnych narzędzi statystycznych do detekcji asymetrii. W konsekwencji znaczna część przeprowadzanych meta-analiz publikowana jest mimo występującej zdiagnozowanej asymetrii. Badania takie wymagają jednakże dobrego uzasadnienia takiego postępowania.

Wykres lejkowy

(-0.9,-0.9)

\rput(3.5,1){\scriptsize bias}

\rput(5.5,1.9){\scriptsize obciążenie publikacyjne}

\rput(5.9,1.3){\scriptsize asymetryczny wykres}

\rput(6.5,1.6){\tiny brak badań w prawym dolnym roku wykresu}

\end{pspicture}](/lib/exe/fetch.php?media=wiki:latex:/imgc498871d76b1ee80598ed43761c46c32.png)

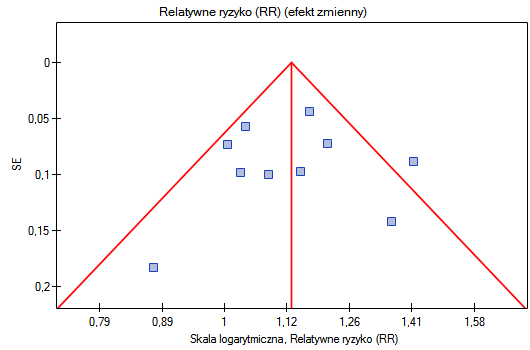

Standardowym sposobem sprawdzenia obciążenia publikacyjnego w postaci asymetrii jest wykres lejkowy, pokazujący zależność pomiędzy wielkością badania (oś Y) a wielkością efektu podsumowującego (oś X). Zakłada się, że duże badania (umieszczone w górnej części wykresu) w prawidłowo dobranym zestawie, zlokalizowane są blisko siebie i wyznaczają środek leja, a badania mniejsze znajdują się niżej oraz są bardziej zróżnicowane i symetrycznie rozłożone. Zamiast wielkości badania na osi Y można przedstawić błąd efektu w danym badaniu, co jest lepszym rozwiązaniem niż przedstawienie samej wielkości badania. Błąd efektu jest bowiem miarą wskazującą na jakość badania i niosącą w sobie również informację o jego liczności.

Test Egger'a

Ponieważ interpretacja wykresu lejkowego jest zawsze subiektywna, pomocą może być wykorzystanie współczynnika Egger'a (Egger 19971)) - wyrazu wolnego w dopasowanej prostej regresji. Współczynnik ten bazuje na korelacji pomiędzy odwrotnością błędu standardowego i stosunkiem wielkości efektu do jego błędu. Czym bardziej oddalona od 0 wartość współczynnika, tym większa asymetria. Kierunek współczynnika określa rodzaj asymetrii: wartość dodatnia wraz z dodatnim przedziałem ufności dla niej wskazuje na zbyt wysoką wielkość efektu w małych badaniach a ujemna wraz z ujemnym przedziałem ufności na zbyt niską wielkość efektu w małych badaniach.

Uwaga! Test Egger'a powinien być używany tylko przy dużym zróżnicowaniu wielkości badań i występowaniu badania o średniej wielkości.

Uwaga!

Przy niewielu badaniach (małej liczbie  ) trudno jest osiągnąć istotny wynik mimo widocznej asymetrii.

) trudno jest osiągnąć istotny wynik mimo widocznej asymetrii.

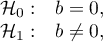

Hipotezy:

gdzie:

- to wyraz wolny w równaniu regresji Egger'a.

- to wyraz wolny w równaniu regresji Egger'a.

Statystyka testowa ma postać:

gdzie:

- błąd standardowy wyrazu wolnego.

- błąd standardowy wyrazu wolnego.

Statystyka testowa ma rozkład t-Studenta z  stopniami swobody.

stopniami swobody.

Wyznaczoną na podstawie statystyki testowej wartość  porównujemy z poziomem istotności

porównujemy z poziomem istotności  :

:

Badanie liczby „Fail-safe”

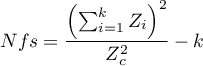

Nfs Rosenthal’a - liczba „Fail-safe” opisana przez Rosenthal’a (19792)) określa liczbę prac nie wskazujących na występowanie efektu (np. różnica średnich równa 0, iloraz szans równy 1 itp.) jaka jest potrzebna by zredukować efekt podsumowujący z istotnego statystycznie do statystycznie nieistotnego.

gdzie:

- wartość statystyki testowej (o rozkładzie normalnym) danego badania,

- wartość statystyki testowej (o rozkładzie normalnym) danego badania,

- wartość krytyczna rozkładu normalnego dla zadanego poziomu istotności,

- wartość krytyczna rozkładu normalnego dla zadanego poziomu istotności,

- liczba badań w meta-analizie.

- liczba badań w meta-analizie.

Rosenthal (1984) określił liczbę prac będącą punktem odcięcia jako  . Wyznaczając iloraz

. Wyznaczając iloraz  i punktu odcięcia uzyskujemy współczynnik(fs). Według interpretacji Rosenthal'a, jeśli współczynnik(fs) będzie większy niż 1, to prawdopodobieństwo obciążenia publikacyjnego jest minimalne.

i punktu odcięcia uzyskujemy współczynnik(fs). Według interpretacji Rosenthal'a, jeśli współczynnik(fs) będzie większy niż 1, to prawdopodobieństwo obciążenia publikacyjnego jest minimalne.

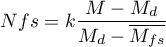

Nfs Orwin’a - liczba „Fail-safe” opisana przez Orwin’a (19833)) określa liczbę prac o średnim efekcie wskazanym przez badacza  , jaka jest potrzebna by zredukować efekt podsumowujący do pożądanej wielkości

, jaka jest potrzebna by zredukować efekt podsumowujący do pożądanej wielkości  wskazanej przez badacza.

wskazanej przez badacza.

gdzie:

- efekt podsumowujący uzyskany w meta-analizie.

- efekt podsumowujący uzyskany w meta-analizie.

Przykład c.d. (plik MetaanalizaRR.pqs)

Badając wpływ palenia papierosów na wystąpienie choroby X sprawdzono założenie dotyczące asymetrii badań, a więc obciążenia publikacyjnego. W tym celu w oknie analizy wybrano opcję Badanie asymetrii oraz wskazano wykres lejkowy.

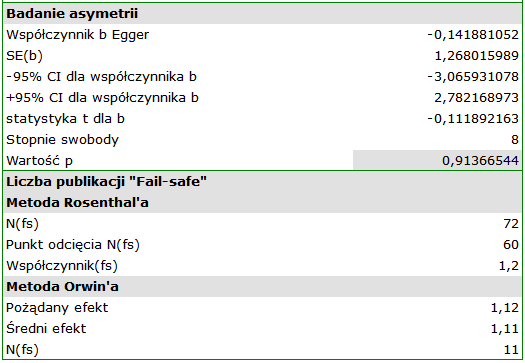

Wynik testu Eggera nie są istotne statystycznie (p=0.9137), co wskazuje na brak obciążenia publikacyjnego.

Punkty, przedstawiające poszczególne badania są rozłożone symetrycznie na wykresie lejkowym. Co prawda jedno badanie znajduje się poza obrębem trójkąta (Badanie 3), ale jest blisko jego brzegów. Na podstawie wykresu również nie mamy zasadniczych zastrzeżeń co do doboru badań, jedyna wątpliwość dotyczy badania trzeciego.

Liczba publikacji „Fail-safe” wyznaczona metodą Rosenthal'a jest duża i wynosi 72. Zatem, jeśli efekt podsumowujący (wspólne dla wszystkich badań relatywne ryzyko) miałby być nieistotny statystycznie (palenie papierosów miałoby nie wpływać na ryzyko choroby X), należałoby dołączyć do zebranych prac jeszcze 72 prace w których relatywne ryzyko wynosi jeden. Uzyskany efekt można więc uznać za stabilny, gdyż nie będzie można łatwo (niewielką liczbą prac) podważyć uzyskanego efektu.

Uzyskane, wspólne relatywne ryzyko wynosi RR=1.13. Wykorzystując metodę Orwin'a sprawdzono jak wiele prac o relatywnym ryzyku równym 1.11 potrzeba włączyć, by wspólne relatywne ryzyko spadło do wielkości 1.12. Uzyskany rezultat to 11 prac. Natomiast zmniejszając wielkość relatywnego ryzyka z 1.11 do 1.10 już tylko 5 prac potrzeba by wspólne relatywne ryzyko wyniosło 1.12.

1)

Egger M., Smith G. D., Schneider M., Minder C (1997), Bias in meta-analysis detected by a simple, graphical test. BMJ, 315(7109):629-634

2)

Rosenthal R. (1979), The „file drawer problem” and tolerance for null results. Psychological Bulletin, 5, 638-641

3)

Orwin R. G. (1983), A Fail-SafeN for Effect Size in Meta-Analysis. J Educ Behav Stat, 8(2):157-159

statpqpl/metapl/asymetr.txt · ostatnio zmienione: 2020/11/05 12:21 przez admin

Narzędzia strony

Wszystkie treści w tym wiki, którym nie przyporządkowano licencji, podlegają licencji: CC Attribution-Noncommercial-Share Alike 4.0 International