Spis treści

Testy nieparametryczne

Współczynnik Kappa Cohena i test badający jego istotność

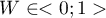

Współczynnik Kappa Cohena (ang. Cohen's Kappa), Cohen J. (1960)1), określa stopień zgodności dwukrotnych pomiarów tej samej zmiennej w różnych warunkach. Pomiaru tej samej zmiennej może dokonać dwóch różnych sędziów (odtwarzalność) lub jeden sędzia może dokonać pomiaru dwukrotnie (powtarzalność). Współczynnik  wyznacza się dla zależnych zmiennych kategorialnych, a jego wartość zawiera się w przedziale od -1 do 1. Wartość 1 oznacza pełną zgodność, wartość 0 oznacza zgodność na poziomie takim samym jaki powstałby dla losowego rozłożenia danych w tabeli kontyngencji. Poziom pomiędzy 0 a -1 jest w praktyce niewykorzystywany. Ujemna wartość

wyznacza się dla zależnych zmiennych kategorialnych, a jego wartość zawiera się w przedziale od -1 do 1. Wartość 1 oznacza pełną zgodność, wartość 0 oznacza zgodność na poziomie takim samym jaki powstałby dla losowego rozłożenia danych w tabeli kontyngencji. Poziom pomiędzy 0 a -1 jest w praktyce niewykorzystywany. Ujemna wartość  oznacza zgodność na poziomie mniejszym niż powstała dla losowego rozłożenia danych w tabeli kontyngencji. Współczynnik

oznacza zgodność na poziomie mniejszym niż powstała dla losowego rozłożenia danych w tabeli kontyngencji. Współczynnik  można wyliczać na podstawie danych surowych albo z wykonanej na podstawie danych surowych tabeli kontyngencji o wymiarach

można wyliczać na podstawie danych surowych albo z wykonanej na podstawie danych surowych tabeli kontyngencji o wymiarach  .

.

W zależności od potrzeb można wyznaczać Kappę nieważoną (czyli Kappę Cohena) lub Kappę ważoną. Przydzielane wagi ( ) odnoszą się do poszczególnych komórek tabeli kontyngencji, na przekątnej wynoszą 1 a poza przekątną należą do przedziału

) odnoszą się do poszczególnych komórek tabeli kontyngencji, na przekątnej wynoszą 1 a poza przekątną należą do przedziału  .

.

Kappa nieważona

Wyliczana jest dla danych, których kategorii nie da się uporządkować np. dane pochodzą od pacjentów, których dzielimy ze względu na rodzaj choroby jaka została zdiagnozowana, a chorób tych nie można uporządkować np. zapalenie płuc  , zapalenie oskrzeli

, zapalenie oskrzeli  i inne

i inne  . W takiej sytuacji można sprawdzać zgodność diagnoz wystawionych przez dwóch lekarzy stosując nieważoną Kappę, czyli Kappę Cohena. Niezgodność par

. W takiej sytuacji można sprawdzać zgodność diagnoz wystawionych przez dwóch lekarzy stosując nieważoną Kappę, czyli Kappę Cohena. Niezgodność par  oraz

oraz  traktowana będzie równoważnie, a więc wagi poza przekątną macierzy wag będą zerowane.

traktowana będzie równoważnie, a więc wagi poza przekątną macierzy wag będą zerowane.

Kappa ważona

W sytuacji kiedy kategorie danych mogą być posortowane np. dane pochodzą od pacjentów, których dzielimy ze względu na stopień zmian chorobowych na: brak zmian  , zmiany łagodne

, zmiany łagodne  , podejrzenie raka

, podejrzenie raka  , rak

, rak  , budować można zgodność wystawionych ocen przez dwóch radiologów uwzględniając możliwość sortowania. Za bardziej niezgodne pary ocen mogą być wówczas uznane oceny

, budować można zgodność wystawionych ocen przez dwóch radiologów uwzględniając możliwość sortowania. Za bardziej niezgodne pary ocen mogą być wówczas uznane oceny  niż

niż  . By tak było, by kolejność kategorii wpływała na wynik zgodności, wyznaczać należy ważoną Kappę.

. By tak było, by kolejność kategorii wpływała na wynik zgodności, wyznaczać należy ważoną Kappę.

Przydzielane wagi mogą mieć postać liniową lub kwadratową.

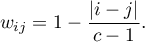

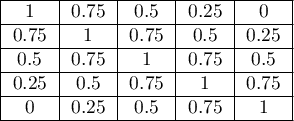

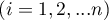

- Wagi liniowe (Cicchetti, 19712)) - wyliczane według wzoru:

Czym większe oddalenie od przekątnej macierzy tym mniejsza waga, przy czym wagi maleją proporcjonalnie. Przykładowe wagi dla macierzy wielkości 5×5 przedstawia tabela:

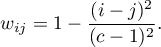

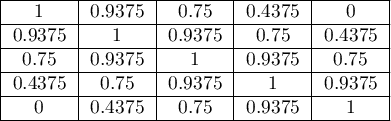

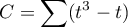

- Wagi kwadratowe (Cohen, 19683)) - wyliczane według wzoru:

Czym większe oddalenie od przekątnej macierzy tym mniejsza waga, przy czym wagi maleją wolniej w bliższej odległości od przekątnej i szybciej w odległości dalszej. Przykładowe wagi dla macierzy wielkości 5×5 przedstawia tabela:

Wagi kwadratowe cieszą się większym zainteresowaniem ze względu na praktyczną interpretację współczynnika Kappa, który w tym przypadku tożsamy jest ze współczynnikiem korelacji wewnątrzklasowej 4).

By wyznaczyć zgodność współczynnikiem Kappa dane przedstawia się w postaci tabeli liczności obserwowanych  , dalej tą tabelę przekształca się w tabelę kontyngencji prawdopodobieństw

, dalej tą tabelę przekształca się w tabelę kontyngencji prawdopodobieństw  .

.

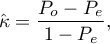

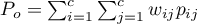

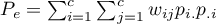

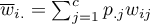

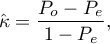

Współczynnik Kappa ( ) wyraża się wtedy wzorem:

) wyraża się wtedy wzorem:

gdzie:

,

,

,

,

,

,  - sumy końcowe kolumn i wierszy tabeli kontyngencji prawdopodobieństw.

- sumy końcowe kolumn i wierszy tabeli kontyngencji prawdopodobieństw.

Uwaga!

oznacza współczynnik zgodności w próbie, natomiast

oznacza współczynnik zgodności w próbie, natomiast  w populacji.

w populacji.

Błąd standardowy dla Kappa wyraża się wzorem:

![LaTeX \begin{displaymath}

SE_{\hat \kappa}=\frac{1}{(1-P_e)\sqrt{n}}\sqrt{\sum_{i=1}^{c}\sum_{j=1}^{c}p_{i.}p_{.j}[w_{ij}-(\overline{w}_{i.}+(\overline{w}_{.j})]^2-P_e^2}

\end{displaymath}](/lib/exe/fetch.php?media=wiki:latex:/img059555813b7a0927359f9000c829f6fe.png) gdzie:

gdzie:

,

,

.

.

Test Z do sprawdzania istotności współczynnika Kappa Cohena ( ) (ang. The Z test of significance for the Cohen's Kappa) Fleiss (20035)) służy do weryfikacji hipotezy o zgodności wyników dwukrotnych pomiarów

) (ang. The Z test of significance for the Cohen's Kappa) Fleiss (20035)) służy do weryfikacji hipotezy o zgodności wyników dwukrotnych pomiarów  i

i  cechy

cechy  i opiera się na współczynniku

i opiera się na współczynniku  wyliczonym dla próby.

wyliczonym dla próby.

Podstawowe warunki stosowania:

- pomiar na skali nominalnej (Kappa Cohena - nieważona) i skali porządkowej (Kappa ważona).

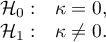

Hipotezy:

Statystyka testowa ma postać:

gdzie:

![LaTeX $\displaystyle{SE_{\kappa_{distr}}=\frac{1}{(1-P_e)\sqrt{n}}\sqrt{\sum_{i=1}^c\sum_{j=1}^c p_{ij}[w_{ij}-(\overline{w}_{i.}+\overline{w}_{.j})(1-\hat \kappa)]^2-[\hat \kappa-P_e(1-\hat \kappa)]^2}}$](/lib/exe/fetch.php?media=wiki:latex:/imgc30723ad5a68d25b44687da3bff2c069.png) .

.

Statystyka  ma asymptotycznie (dla dużych liczności) rozkład normalny.

ma asymptotycznie (dla dużych liczności) rozkład normalny.

Wyznaczoną na podstawie statystyki testowej wartość  porównujemy z poziomem istotności

porównujemy z poziomem istotności  :

:

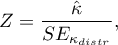

Okno z ustawieniami opcji testu istotności Kappa-Cohena wywołujemy poprzez menu Statystyka→Testy nieparametryczne→Kappa-Cohena lub poprzez Kreator.

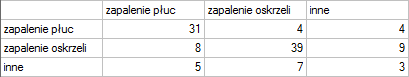

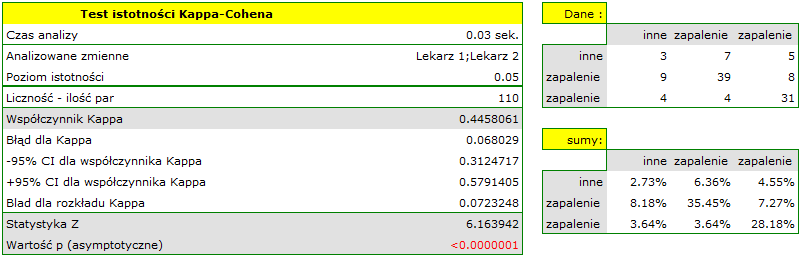

Badamy zgodność diagnozy postawionej przez 2 lekarzy. W tym celu pobieramy próbę 110 pacjentów szpitala dziecięcego. Lekarze przyjmują pacjentów w sąsiednich gabinetach. Każdy z pacjentów jest najpierw badany przez lekarza A a następnie przez lekarza B. Diagnozy postawione przez lekarzy przedstawia poniższa tabela.

Hipotezy:

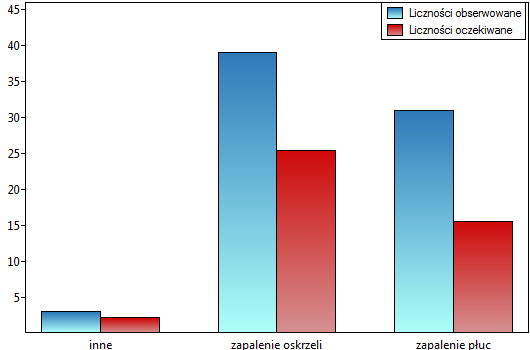

Moglibyśmy badać zgodność diagnozy poprzez zwykły procent wartości zgodnych. W naszym przykładzie zgodną diagnozę lekarze postawili dla 73 pacjentów (31+39+3=73) co stanowi 66.36% badanej grupy. Współczynnik Kappa wprowadza korekcję tej wartości o szanse na zgodność (tzn. w korekcji o tę zgodność, która pojawia się dla przypadkowego rozłożenia danych w tabeli).

Zgodność wyrażona współczynnikiem  jest mniejsza niż ta nie skorygowana o szanse na zgodność.

jest mniejsza niż ta nie skorygowana o szanse na zgodność.

Wartość  . Wynik taki, na poziomie istotności

. Wynik taki, na poziomie istotności  , świadczy o zgodności opinii tych 2 lekarzy.

, świadczy o zgodności opinii tych 2 lekarzy.

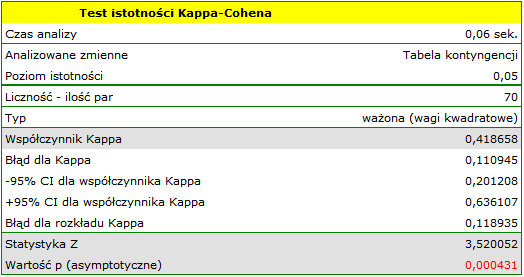

Przykład (plik radiologia.pqs)

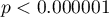

W obrazie radiologicznym oceniano uszkodzenie wątroby w następujących kategoriach: brak zmian  , zmiany łagodne

, zmiany łagodne  , podejrzenie raka

, podejrzenie raka  , rak

, rak  . Oceny dokonywało dwóch niezależnych radiologów bazując na grupie 70 pacjentów. Chcemy sprawdzić zgodność postawionej diagnozy.

. Oceny dokonywało dwóch niezależnych radiologów bazując na grupie 70 pacjentów. Chcemy sprawdzić zgodność postawionej diagnozy.

Hipotezy:

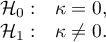

Ze względu na to, że diagnoza wystawiona jest na skali porządkowej, właściwą miarą zgodności byłby ważony współczynnik Kappa.

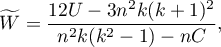

Ponieważ dane koncentrują się głównie na głównej przekątnej macierzy i w jej bliskim sąsiedztwie, współczynnik ważony wagami liniowymi jest niższy ( ) niż współczynnik wyznaczony dla wag kwadratowych (

) niż współczynnik wyznaczony dla wag kwadratowych ( ). W obu sytuacjach jest to wynik istoty statystycznie (na poziomie istotności

). W obu sytuacjach jest to wynik istoty statystycznie (na poziomie istotności  ), wartość

), wartość  wynosi odpowiednio: 0.000007 i 0.000431.

wynosi odpowiednio: 0.000007 i 0.000431.

Gdyby w ocenach istniała duża niezgodność dotycząca dwóch skrajnych przypadków i para: (brak zmian i rak) znajdująca się w prawym górnym roku tabeli występowała zdecydowanie częściej, np. 15 razy, wówczas taki duży brak zgodności widoczny będzie bardziej, gdy wykorzystamy wagi kwadratowe (współczynnik Kappa drastycznie spadnie) niż przy wykorzystaniu wag liniowych.

Współczynnik zgodności Kendalla i test badający jego istotność

Współczynnik zgodności  Kendalla (ang. Kendall's Coefficient of Concordance) opisany w pracy Kendalla i Babingtona-Smitha (1939)6) oraz Wallisa (1939)7) stosuje się w sytuacji, gdy dysponujemy rankingami pochodzącymi z różnych źródeł (od różnych sędziów) i dotyczącymi kilku (

Kendalla (ang. Kendall's Coefficient of Concordance) opisany w pracy Kendalla i Babingtona-Smitha (1939)6) oraz Wallisa (1939)7) stosuje się w sytuacji, gdy dysponujemy rankingami pochodzącymi z różnych źródeł (od różnych sędziów) i dotyczącymi kilku ( ) obiektów a zależy nam na ocenie zgodności tych rankingów. Często używa się go do mierzenia siły sędziowskiej rzetelności, czyli stopnia w jakim oceny sędziów są zgodne.

) obiektów a zależy nam na ocenie zgodności tych rankingów. Często używa się go do mierzenia siły sędziowskiej rzetelności, czyli stopnia w jakim oceny sędziów są zgodne.

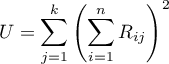

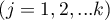

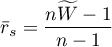

Współczynnik zgodności Kendalla wyznacza się dla skali porządkowej lub interwałowej, a jego wartość wylicza się według wzoru:

gdzie:

- liczba różnych zbiorów ocen (ilość sędziów),

- liczba różnych zbiorów ocen (ilość sędziów),

- liczba rangowanych obiektów,

- liczba rangowanych obiektów,

,

,

- rangi przypisane kolejnym obiektom

- rangi przypisane kolejnym obiektom  , oddzielnie dla każdego z sędziów

, oddzielnie dla każdego z sędziów  ,

,

- korekta na rangi wiązane,

- korekta na rangi wiązane,

- liczba przypadków wchodzących w skład rangi wiązanej.

- liczba przypadków wchodzących w skład rangi wiązanej.

Wzór na współczynnik zawiera poprawkę na rangi wiązane  . Poprawka ta jest stosowana, gdy rangi wiązane występują (gdy nie ma rang wiązanych poprawka ta nie jest wyliczana, gdyż wówczas

. Poprawka ta jest stosowana, gdy rangi wiązane występują (gdy nie ma rang wiązanych poprawka ta nie jest wyliczana, gdyż wówczas  ).

).

Uwaga!

oznacza współczynnik zgodności Kendalla w populacji, natomiast

oznacza współczynnik zgodności Kendalla w populacji, natomiast  w próbie.

w próbie.

Wartość  interpretujemy w następujący sposób:

interpretujemy w następujący sposób:

oznacza silną zgodność w ocenie poszczególnych obiektów przez sędziów;

oznacza silną zgodność w ocenie poszczególnych obiektów przez sędziów; oznacza brak zgodności w ocenie poszczególnych obiektów przez sędziów.

oznacza brak zgodności w ocenie poszczególnych obiektów przez sędziów.

Współczynnik zgodności  Kendalla a współczynnik

Kendalla a współczynnik  Spearmana:

Spearmana:

- Gdy wyliczymy wartość współczynnika korelacji Spearmana

dla wszystkich możliwych par rankingów, to średni współczynnik

dla wszystkich możliwych par rankingów, to średni współczynnik  - oznaczony przez

- oznaczony przez  , jest funkcją liniową wartości współczynnika

, jest funkcją liniową wartości współczynnika  wyliczonego na podstawie tych danych:

wyliczonego na podstawie tych danych:

Współczynnik zgodności  Kendalla a ANOVA Friedmana:

Kendalla a ANOVA Friedmana:

- Współczynnik zgodności

Kendalla i ANOVA Friedmana bazują na tym samym modelu matematycznym. W rezultacie wartość statystyki testowej testu chi-kwadrat do sprawdzania istotności współczynnika zgodności Kendalla i wartość statystyki testowej ANOVA Friedmana jest taka sama.

Kendalla i ANOVA Friedmana bazują na tym samym modelu matematycznym. W rezultacie wartość statystyki testowej testu chi-kwadrat do sprawdzania istotności współczynnika zgodności Kendalla i wartość statystyki testowej ANOVA Friedmana jest taka sama.

Test chi-kwadrat do sprawdzania istotności współczynnika zgodności Kendalla

Podstawowe warunki stosowania:

- pomiar na skali porządkowej lub interwałowej.

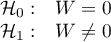

Hipotezy:

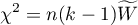

Statystyka testowa ma postać:

Statystyka ta ma asymptotycznie (dla dużych liczności) rozkład chi-kwadrat z liczbą stopni swobody wyliczaną z wzoru:  .

.

Wyznaczoną na podstawie statystyki testowej wartość  porównujemy z poziomem istotności

porównujemy z poziomem istotności  :

:

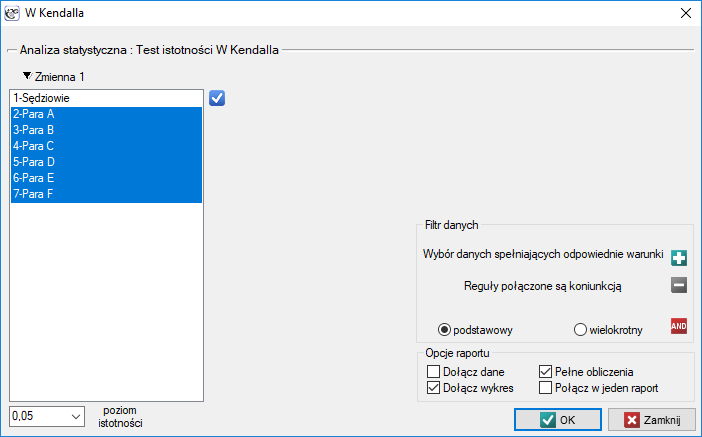

Okno z ustawieniami opcji testu istotności W Kendalla wywołujemy poprzez menu Statystyka→Testy nieparametryczne→W Kendalla lub poprzez ''Kreator''.

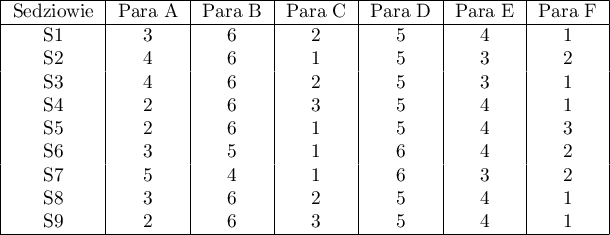

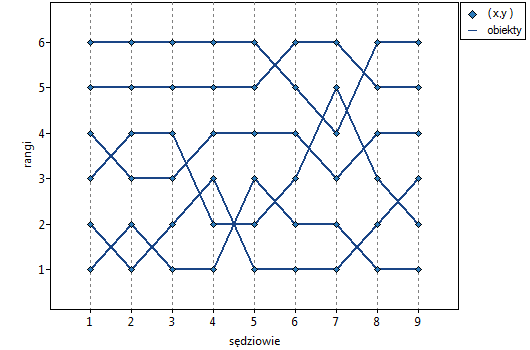

W systemie szóstkowym oceny par tanecznych 9 sędziów punktuje m.in. wrażenie artystyczne. Sędziowie rozpoczynają wystawianie oceny od porównania zawodników względem siebie i ustawienia ich na określonym miejscu (tworzą ich ranking). Sprawdzimy, czy rangi przypisane przez sędziów są zgodne:

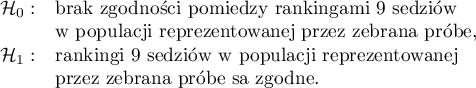

Hipotezy:

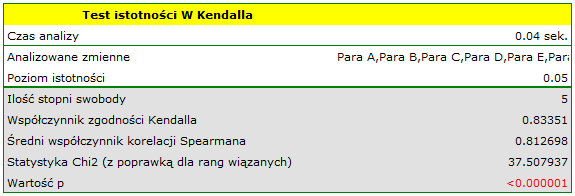

Porównując wartość  z poziomem istotności

z poziomem istotności  , stwierdziliśmy, że oceny sędziów są statystycznie zgodne. Siła tej zgodności jest wysoka i wynosi

, stwierdziliśmy, że oceny sędziów są statystycznie zgodne. Siła tej zgodności jest wysoka i wynosi  , podobnie jak średni współczynnik korelacji monotonicznej Spearmana

, podobnie jak średni współczynnik korelacji monotonicznej Spearmana  . Wynik ten możemy przedstawić na wykresie, na którym oś X reprezentuje kolejnych sędziów. Wówczas im częściej przecinają się linie, (które powinny być równoległe do osi X, gdy zgodność jest pełna), tym słabszą zgodność reprezentują oceny sędziów.

. Wynik ten możemy przedstawić na wykresie, na którym oś X reprezentuje kolejnych sędziów. Wówczas im częściej przecinają się linie, (które powinny być równoległe do osi X, gdy zgodność jest pełna), tym słabszą zgodność reprezentują oceny sędziów.

Współczynnik Kappa Fleissa i test badający jego istotność

Współczynnik ten określa zgodność pomiarów prowadzonych przez kliku sędziów (Fleiss, 19718)) i jest rozszerzeniem współczynnika Kappa Cohena, pozwalającego na badanie zgodności jedynie dwóch sędziów. Przy czym, należy zaznaczyć że każdy z  losowo wybranych obiektów może być oceniany przez inny losowy zestaw

losowo wybranych obiektów może być oceniany przez inny losowy zestaw  sędziów. Analiza opiera się na danych przekształconych do tabeli o

sędziów. Analiza opiera się na danych przekształconych do tabeli o  wierszach i

wierszach i  kolumnach, gdzie

kolumnach, gdzie  stanowi liczbę możliwych kategorii, do których sędziowie przydzielają badane obiekty. Zatem w każdym wierszu tabeli podano

stanowi liczbę możliwych kategorii, do których sędziowie przydzielają badane obiekty. Zatem w każdym wierszu tabeli podano  czyli liczbę sędziów wydających określone w danej kolumnie opinie.

czyli liczbę sędziów wydających określone w danej kolumnie opinie.

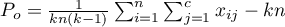

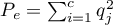

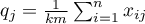

Współczynnik Kappa ( ) wyraża się wtedy wzorem:

) wyraża się wtedy wzorem:

gdzie:

,

,

,

,

.

.

Wartość  oznacza pełną zgodność sędziów, natomiast

oznacza pełną zgodność sędziów, natomiast  oznacza zgodność jaka powstałaby, gdyby opinie sędziów wydane były w sposób losowy. Wartości ujemne Kappa wskazują natomiast na zgodność mniejszą niż na poziomie losowym.

oznacza zgodność jaka powstałaby, gdyby opinie sędziów wydane były w sposób losowy. Wartości ujemne Kappa wskazują natomiast na zgodność mniejszą niż na poziomie losowym.

Dla współczynnika  można wyznaczyć błąd standardowy

można wyznaczyć błąd standardowy  , który pozwala na zbadanie istotności statystycznej i wyznaczenie asymptotycznych przedziałów ufności.

, który pozwala na zbadanie istotności statystycznej i wyznaczenie asymptotycznych przedziałów ufności.

Test Z do sprawdzania istotności współczynnika Kappa Fleissa ( ) (ang. The Z test of significance for the Fleiss's Kappa) Fleiss (20039)) służy do weryfikacji hipotezy o zgodności ocen kilku sędziów i opiera się na współczynniku

) (ang. The Z test of significance for the Fleiss's Kappa) Fleiss (20039)) służy do weryfikacji hipotezy o zgodności ocen kilku sędziów i opiera się na współczynniku  wyliczonym dla próby.

wyliczonym dla próby.

Podstawowe warunki stosowania:

- pomiar na skali nominalnej - ewentualne uporządkowanie kategorii nie jest brane pod uwagę.

Hipotezy:

Statystyka testowa ma postać:

Statystyka  ma asymptotycznie (dla dużych liczności) rozkład normalny.

ma asymptotycznie (dla dużych liczności) rozkład normalny.

Wyznaczoną na podstawie statystyki testowej wartość  porównujemy z poziomem istotności

porównujemy z poziomem istotności  :

:

Uwaga! Wyznaczanie współczynnika Kappa Fleissa zbliżone jest koncepcyjnie do metody Mantela-Haenszela. Wyznaczona Kappa jest ogólną miarą podsumowującą zgodność wszystkich ocen sędziowskich i może być wyznaczona jako Kappa utworzona z poszczególnych warstw, którymi są konkretne oceny sędziowskie (Fleiss, 200310)). Dlatego, jako podsumowanie każdej warstwy można wyznaczyć zgodność sędziowską (współczynnik Kappa) podsumowującą każdą możliwą ocenę z osobna.

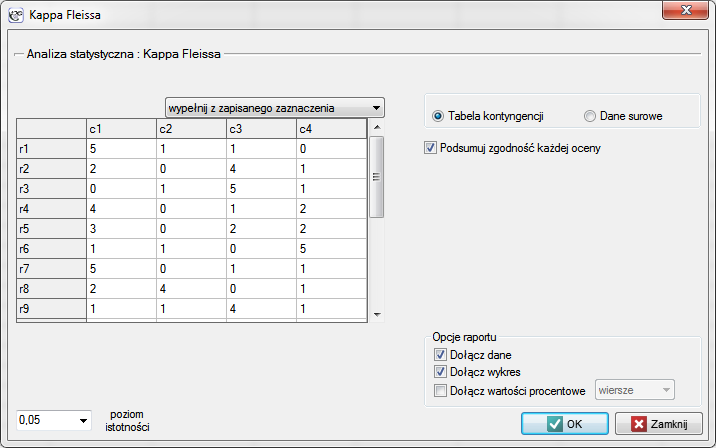

Okno z ustawieniami opcji testu istotności Kappa-Fleissa wywołujemy poprzez menu Statystyka→Testy nieparametryczne→Kappa-Fleissa

Przykład (plik temperament.pqs)

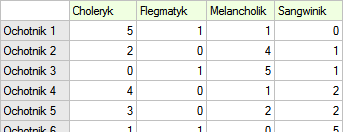

20 ochotników bierze udział w zabawie mającej na celu ustalenie typu osobowości badanych. Każdy z ochotników dysponuje oceną wystawioną przez 7 różnych obserwatorów (najczęściej osób z bliskiego otoczenia lub rodziny). Każdy z obserwatorów został zapoznany z podstawowymi cechami opisującymi temperament w poszczególnych typach osobowości: choleryk, flegmatyk, melancholik, sangwinik. Badamy zgodność obserwatorów w przypisywaniu typów osobowości. Fragment danych przedstawia poniższa tabela.

Hipotezy:

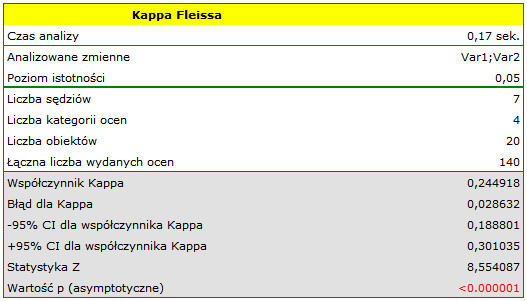

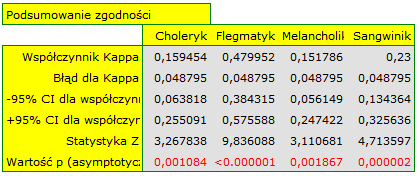

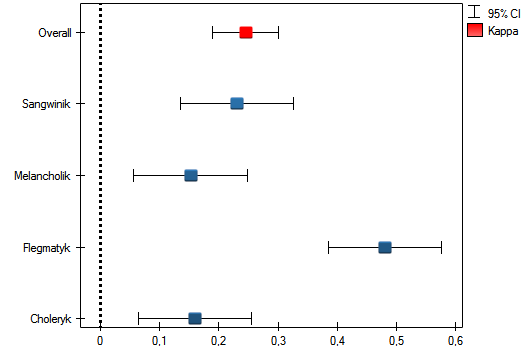

Obserwujemy nieduży współczynnik Kappa = 0.244918, lecz istotny statystycznie (p<0.000001), co oznacza nieprzypadkową zgodność ocen sędziowskich. Istotna zgodność dotyczy każdej oceny, czego potwierdzeniem jest raport podsumowujący zgodność dla każdej warstwy (dla każdej oceny) oraz wykres prezentujący poszczególne współczynniki Kappa i Kappę podsumowującą całość.

Ciekawy może być fakt, że najwyższa zgodność dotyczy oceny flegmatyków (Kappa=0.479952).

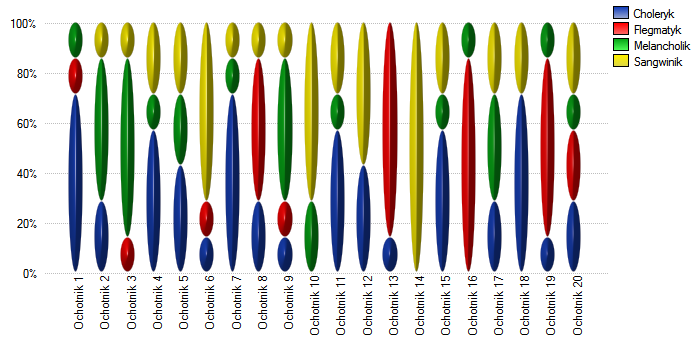

Przy niewielkiej liczbie obserwowanych osób warto również wykonać wykres obrazujący w jaki sposób obserwatorzy oceniali każdą z nich.

W tym przypadku tylko osoba nr 14 uzyskała jednoznaczną ocenę typu osobowości - sangwinik. Osoby nr 13 i 16 ocenione były jako typ flegmatyk przez 6 obserwatorów (na 7 możliwych). W przypadku pozostałych osób panowała nieco mniejsza zgodność ocen. Najtrudniejszy do zdefiniowania typ osobowości wydaje się cechować ostatnią osobę, która uzyskała najbardziej różnorodny zestaw ocen.