Testy normalności jednowymiarowej

W badaniu normalności rozkładu zastosowanie mogą mieć różne testy, z których każdy zwraca uwagę na nieco inne aspekty rozkładu Gaussa. Nie można wskazać testu dobrego dla każdego możliwego zestawu danych.

Podstawowy warunek stosowania testów normalności rozkładu:

- pomiar na skali interwałowej.

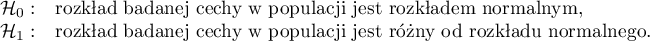

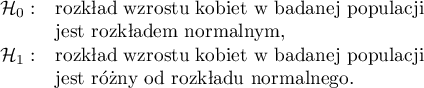

Hipotezy testów normalności rozkładu:

Wyznaczoną na podstawie statystyki testowej wartość  porównujemy z poziomem istotności

porównujemy z poziomem istotności  :

:

Uwaga!!! Badanie normalności rozkładu można przeprowadzać dla zmiennych lub dla różnic wyznaczonych na podstawie dwóch zmiennych.

Test Kołmogorova-Smirnova (ang. Kolmogorov-Smirnov test for normality)

Test zaproponowany przez Kolmogorova (1933)1) jest testem stosunkowo konserwatwnym (trudniej przy jego użyciu udowodnić brak normalności rozkładu). Opiera swoje działanie na wyznaczeniu odległości pomiędzy dystrybuantą empiryczną a teoretyczną rozkładu normalnego. Zaleca się jego stosowanie dla licznych prób, jednak powinien być stosowany w sytuacji, gdy znana jest wartość średnia ( ) i odchylenie standardowe (

) i odchylenie standardowe ( ) dla populacji, z której pochodzi próba. Wówczas możemy sprawdzić, czy rozkład zgodny jest z rozkładem zdefiniowanym przez podaną średnią i odchylenie standardowe.

) dla populacji, z której pochodzi próba. Wówczas możemy sprawdzić, czy rozkład zgodny jest z rozkładem zdefiniowanym przez podaną średnią i odchylenie standardowe.

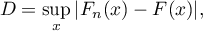

W oparciu o dane z próby zebrane w skumulowany rozkład częstości oraz o odpowiednie wartości pola pod teoretyczną krzywą rozkładu normalnego wyznaczamy wartość statystyki testowej  :

:

gdzie:

- empiryczna dystrybuanta rozkładu normalnego wyliczana w poszczególnych punktach rozkładu, dla

- empiryczna dystrybuanta rozkładu normalnego wyliczana w poszczególnych punktach rozkładu, dla  -elementowej próby ,

-elementowej próby ,

- teoretyczna dystrybuanta rozkładu normalnego.

- teoretyczna dystrybuanta rozkładu normalnego.

Statystyka testu podlega rozkładowi Kołmogorova-Smirnova.

Test Lillieforsa (ang. Lilliefors test for normality)

Test zaproponowany przez Lillieforsa (19672), 19693), 19734)). Jest on poprawką testu Kołmogorova-Smirnova, gdy nie znana jest wartość średnia ( ) i odchylenie standardowe (

) i odchylenie standardowe ( ) dla populacji, z której pochodzi próba. Uznawany jest za nieco mniej konserwatywny od testu Kołmogorova-Smirnova.

) dla populacji, z której pochodzi próba. Uznawany jest za nieco mniej konserwatywny od testu Kołmogorova-Smirnova.

Statystyka testowa  wyznaczana jest na podstawie tej samej formuły, z której korzysta test Kołmogorova-Smirnova, ale podlega rozkładowi Lillieforsa.

wyznaczana jest na podstawie tej samej formuły, z której korzysta test Kołmogorova-Smirnova, ale podlega rozkładowi Lillieforsa.

Test Shapiro-Wilka (ang. Shapiro-Wilk test for normality)

Zaproponowany przez Shapiro oraz Wilka (1965)5) dla mało licznych grup, a następnie zaadoptowany dla grup liczniejszych (do 5000 obiektów) przez Roystona (1992)6)7). Test ten charakteryzuje stosunkowo wysoka moc, co ułatwia dowodzenie braku normalności rozkładu.

Ideę działania testu przedstawia wykres Q-Q plot.

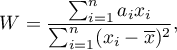

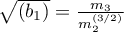

Statystyka testowa Shapiro-Wilka ma postać:

gdzie:

- współczynniki wyznaczane w oparciu o wartości oczekiwane dla statystyk uporządkowanych (ordered statistics), przypisanych wag oraz macierzy kowariancji,

- współczynniki wyznaczane w oparciu o wartości oczekiwane dla statystyk uporządkowanych (ordered statistics), przypisanych wag oraz macierzy kowariancji,

- wartość średnia danych z próby.

- wartość średnia danych z próby.

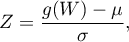

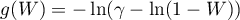

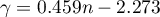

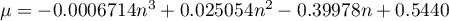

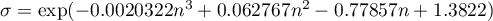

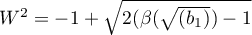

Statystykę tę przekształca się do statystyki o rozkładzie normalnym:

gdzie:

,

,  i

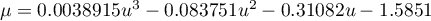

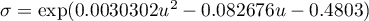

i  - zależą od wielkości próby:

- zależą od wielkości próby:

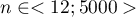

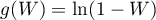

- dla prób małych o licznościach  :

:

,

,

,

,

,

,

;

;

- dla prób dużych o licznościach  :

:

,

,

,

,

,

,

.

.

Test D'Agostino-Pearsona (ang. D'Agostino-Pearson test for normality)

Różne typy analiz statystycznych zakładające normalność są w różnym stopniu wrażliwe na różne rodzaje odejścia od tego założenia. Przyjmuje się, że testy odnoszące się w swoich hipotezach do średnich są bardziej wrażliwe na skośność, a testy porównujące wariancje w większym stopniu zależą od kurtozy.

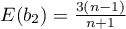

Rozkład normalny charakteryzować powinna zerowa skośność i zerowa kurtoza g2 (lub b2 bliska wartości trzy). W przypadku braku normalności rozkładu, stwierdzonej przez test D'Agostino (1973)8), można sprawdzić czy jest to efektem wysokiej skośności czy kurtozy poprzez test skośności i test kurtozy.

Podobnie jak test Shapiro-Wilka, test D'Agostino charakteryzuje się większą mocą niż test Kołmogorova-Smirnova i test Lillieforsa (D'Agostino 19909)).

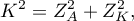

Statystyka testowa ma postać:

gdzie:

- statystyka testowa testu skośności,

- statystyka testowa testu skośności,

- statystyka testowa testu kurtozy.

- statystyka testowa testu kurtozy.

Statystyka ta ma asymptotycznie rozkład chi-kwadrat z dwoma stopniami swobody.

- Test skośności D'Agostino

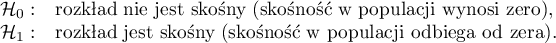

Hipotezy:

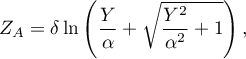

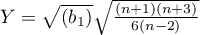

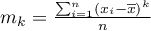

Statystyka testowa ma postać:

gdzie:

,

,

,

,

,

,

,

,

,

,

,

,

.

.

Statystyka  ma asymptotycznie (dla dużych liczności) rozkład normalny.

ma asymptotycznie (dla dużych liczności) rozkład normalny.

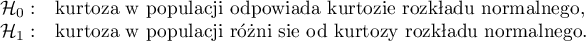

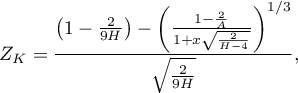

- Test kurtozy D'Agostino

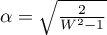

Hipotezy:

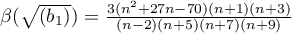

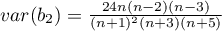

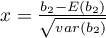

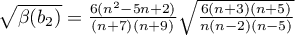

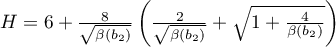

Statystyka testowa ma postać:

gdzie:

,

,

,

,

,

,

,

,

,

,

.

.

Statystyka  ma asymptotycznie (dla dużych liczności) rozkład normalny.

ma asymptotycznie (dla dużych liczności) rozkład normalny.

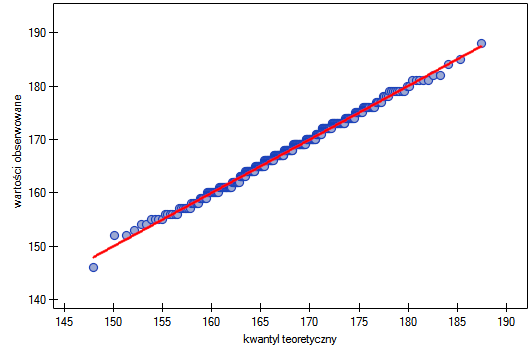

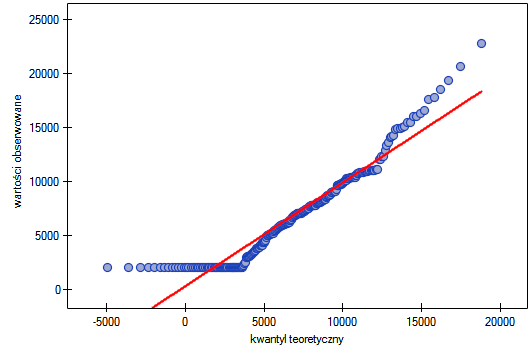

Wykres Kwantyl-Kwantyl (ang. Q-Q plot, Quantile-Quantile plot)

Wykres typu Kwantyl-Kwantyl wykorzystywany jest do przedstawienia zgodności dwóch rozkładów. W przypadku badania zgodności z rozkładem normalny, sprawdza zgodność rozkładu danych (rozkładu empirycznego) z rozkładem teoretycznym Gaussa. Na jego podstawie można wizualnie sprawdzić jak dobrze krzywa rozkładu normalnego jest dopasowana do danych. Jeśli kwantyle rozkładu teoretycznego i rozkładu empirycznego są zgodne, wówczas punkty rozkładają się wzdłuż linii  . Oś pozioma przedstawia kwantyle rozkładu normalnego, oś pionowa kwantyle rozkładu danych.

. Oś pozioma przedstawia kwantyle rozkładu normalnego, oś pionowa kwantyle rozkładu danych.

Możliwe są bardzo różne odstępstwa od rozkładu normalnego - interpretację kilku najczęściej występujących opisuje schemat:

- dane rozłożone na linii, lecz kilka punktów mocno odbiega od linii

- występują wartości odstające w danych

- punkty po lewej stronie wykresu znajdują się powyżej linii, a po prawej poniżej linii

- rozkład charakteryzuje większa obecność wartości odległych od średniej niż jest w rozkładzie normalnym (ujemna kurtoza)

- punkty po lewej stronie wykresu znajdują się poniżej linii, a po prawej powyżej linii

- rozkład charakteryzuje mniejsza obecność wartości odległych od średniej niż jest w rozkładzie normalnym (dodatnia kurtoza)

- punkty po lewej i po prawej stronie wykresu znajdują się powyżej linii

- rozkład prawostronnie skośny (dodatnia skośność);

- punkty po lewej i po prawej stronie wykresu znajdują się poniżej linii

- rozkład lewostronnie skośny (ujemna skośność).

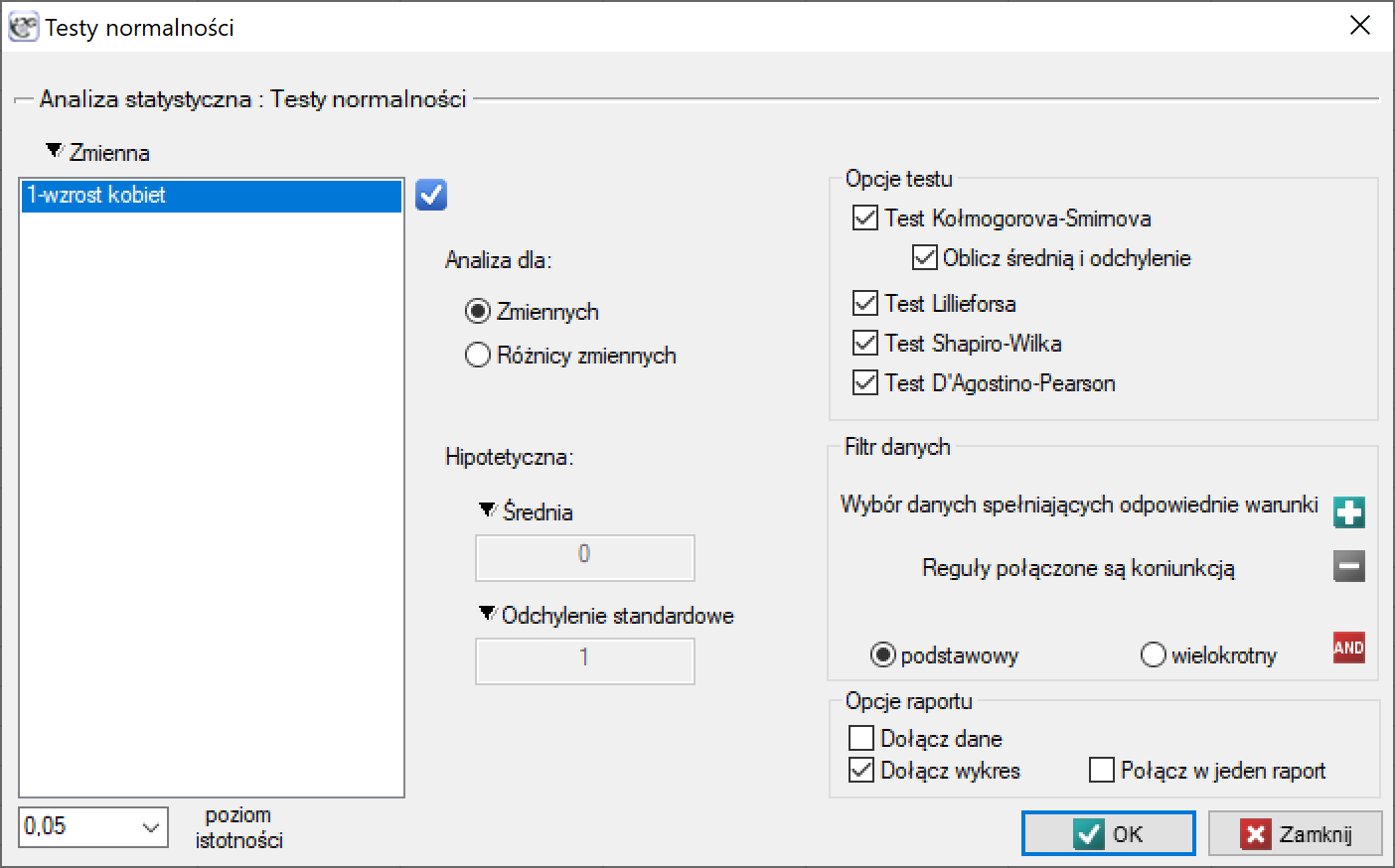

Okno z ustawieniami opcji testów normalności wywołujemy poprzez menu Statystyka→Testy normalności→Normalność jednowymiarowa lub poprzez ''Kreator''.

Przykład (plik Gauss.pqs)

Wzrost kobiet

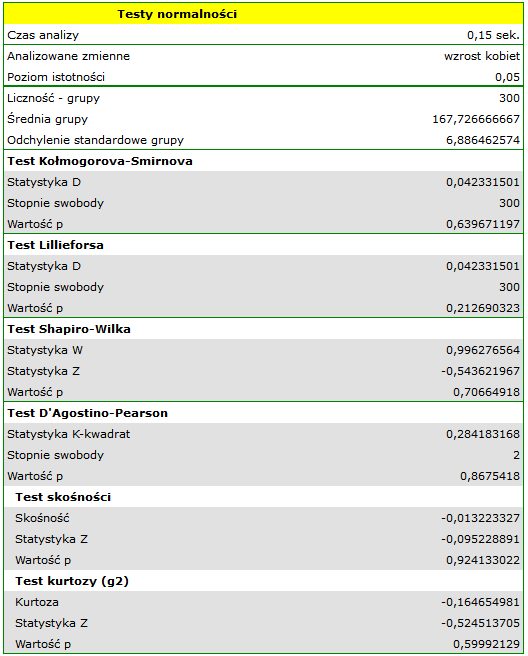

Załóżmy, że wzrost kobiet jest taką cechą, dla której wartość przeciętna wynosi 168cm. Większość kobiet spotykanych na co dzień jest wzrostu, który nie odbiega znacznie od tej przeciętnej. Oczywiście zdarzają się kobiety zupełnie niskie a także bardzo wysokie, ale stosunkowo rzadko. Skoro wartości bardzo niskie i bardzo wysokie występują rzadko, a wartości przeciętne często, możemy się spodziewać, że rozkład wzrostu jest rozkładem normalnym. By się o tym przekonać zmierzono 300 losowo wybranych kobiet.

Hipotezy:

Ponieważ nie znamy średniej ani odchylenia standardowego dla wzrostu kobiet, a jedynie mamy przypuszczenia co do tych wielkości, będą one wyznaczane z próby.

Wszystkie wyznaczone testy wskazują na brak odstępstwa od rozkładu normalnego, ponieważ ich wartości  znajdują się powyżej standardowego poziomu istotności

znajdują się powyżej standardowego poziomu istotności  . Również test badający skośność i kurtozę nie wykazuje odstępstw.

. Również test badający skośność i kurtozę nie wykazuje odstępstw.

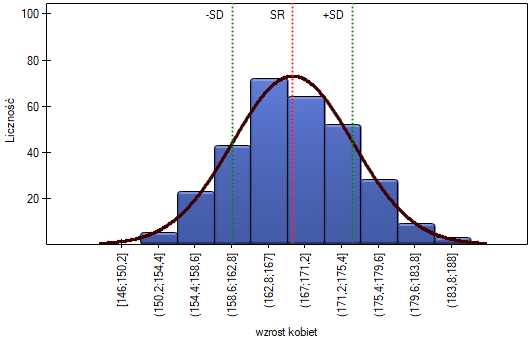

Na wykresie kolumnowym przedstawiliśmy rozkład wzrostu w postaci 10 kolumn. Najliczniejszą grupę stanowią kobiety o wzroście od 167 cm do 171 cm, najmniej liczne są natomiast kobiety niższe niż 150 cm lub wyższe niż 184 cm. Dzwonowa krzywa rozkładu normalnego wydaje się dobrze opisywać ten rozkład.

Na wykresie kwantyl-kwantyl punkty leżą prawie idealnie na linii, co również świadczy o bardzo dobrym dopasowaniu rozkładu normalnego.

Rozkład normalny może zatem zostać uznany, za rozkład jakim charakteryzuje się wzrost kobiet w badanej populacji.

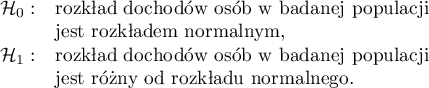

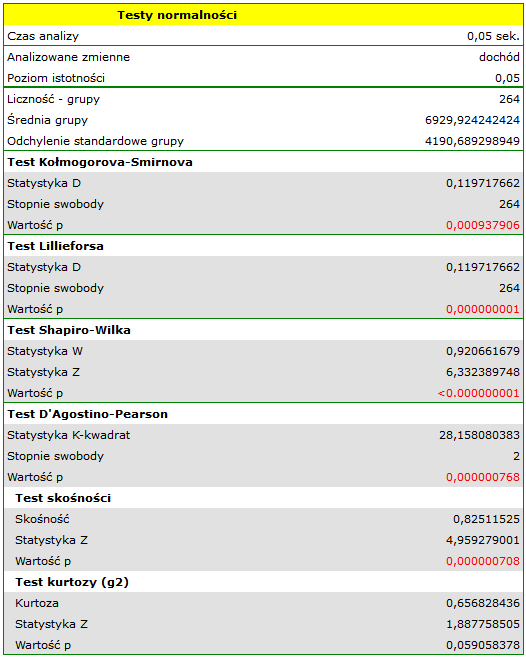

Dochód

Załóżmy, że badamy dochód osób w pewnym kraju. Oczekujemy, że dochody większości osób będą przeciętne, jednak nie będzie osób zarabiających zupełnie mało (poniżej minimalnej pensji narzuconej przez władze), ale będą osoby zarabiające bardzo dużo (prezesi firm) których jest stosunkowo niewielu. By sprawdzić czy dochód osób w badanym kraju ma rozkład normalny zebrano informację o dochodach 264 losowo wybranych osób.

Hipotezy:

Rozkład nie jest rozkładem normalnym, o czym świadczą wszystkie wyniki testów badających normalność rozkładu ( ). Dodatnia i istotna statystycznie (

). Dodatnia i istotna statystycznie ( ) wartość skośności świadczy o zbyt długim prawym ogonie funkcji. Rozkład funkcji jest również bardziej smukły od rozkładu normalnego, ale nie jest to istotna statystycznie różnica (test kurtozy).

) wartość skośności świadczy o zbyt długim prawym ogonie funkcji. Rozkład funkcji jest również bardziej smukły od rozkładu normalnego, ale nie jest to istotna statystycznie różnica (test kurtozy).

Na wykresie kwartyl-kwartyl odstępstwo od rozkładu normalnego jest obrazowane poprzez skośność prawostronną, czyli położenie znacznie powyżej linii początkowych i końcowych punktów wykresu.

W rezultacie zebrane dane nie świadczą o zgodności rozkładu dochodów z rozkładem normalnym.

aaa